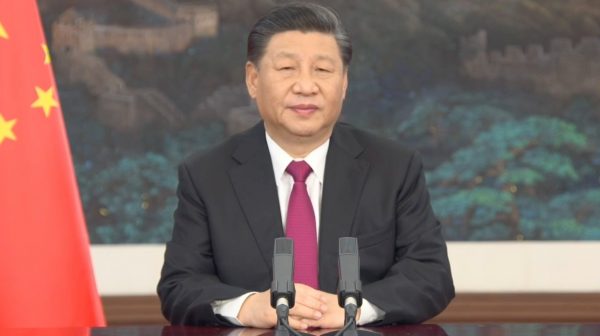

네이버 정석근 대표가 화요일 네이버 AI NOW 이벤트 생중계에서 연설하고있다. [SCREEN CAPTURE]

네이버는 한국어를위한 가장 큰 “인공 지능 모델”을 개발했다고 주장합니다.

인공 지능 모델은 특정 패턴을 인식하기 위해 일련의 데이터를 사용하여 학습하는 기계 학습 프로그램입니다. 복잡성은 매개 변수로 측정됩니다. 매개 변수 수가 많을수록 데이터를 효율적으로 처리 할 수있는 능력이 커집니다.

네이버는 HyperCLOVA에 2,400 억 개의 매개 변수가 있다고 말합니다. Google은 1 조 개의 매개 변수를 위반했다고 주장합니다.

샌프란시스코에서 OpenAI가 개발 한 GPT-3는 1,750 억 개의 매개 변수를 달성했습니다. Microsoft의 T-NLG (Turing Natural Language Generation) 프로그램에는 170 억 개의 매개 변수가 있습니다.

GPT-3은 여러 언어를 처리 할 수 있습니다. 그러나 한국어에 관해서는 네이버는 HyperCLOVA 전문성이 타의 추종을 불허한다고 말합니다.

학습에 사용 된 데이터의 97 %는 한국어 였고 GPT-3는 주로 영어로 훈련되었습니다. 그녀는 HyperCLOVA의 한국어로 된 기계 획득 데이터의 양이 GPT-3보다 6,500 배 더 크다고 덧붙였습니다.

정석근 네이버 CEO는 화요일 네이버 AI NOW 이벤트 생중계에서 “글로벌 IT 리더들이 AI 모델에 대한 투자를 가속화하고 있으며, 그들이 가져올 수있는 파괴적인 혁신을 알고있다”고 말했다.

우리는 외국 플랫폼이 한국 AI 기술을 지배하는 것을보고 싶지 않았습니다. 이러한 상황을 피하기 위해 오픈 소스 기술의 빠른 추종자가되는 것만으로는 충분하지 않았습니다.”

정씨는 머신 러닝의 패러다임 전환이 있다고 말했다. 과거에는 엔지니어가 데이터를 수집하고 전처리하여 머신 러닝에 최적화하고 특정 서비스를위한 모델을 개발했습니다. 그는 그 결과를 다양한 작업을 수행하는 데 재사용 할 수 없다는 것은 말할 것도없고 시간이 걸렸다 고 말했다.

그는 오늘날 연구자들의 목표는 하나의 대규모 모델이 텍스트 요약, 간단한 질문 번역 및 답변과 같은 다양한 문제를 해결할 수있는 “대형 모델”을 개발하는 것이라고 덧붙였습니다.

이를 위해 네이버는 뉴스 기사 50 년 분량에 해당하는 한국어 데이터를 삽입하는 슈퍼 컴퓨터를 구입했다.

네이버의 HyperCLOVA의 궁극적 인 목표는 중소기업, 스타트 업 등 비전문가가 고급 서비스를 개발할 수 있도록하는 것입니다. 예를 들어, 전자 상거래 운영자는 프로그램에 제품 홍보에 적합한 단어를 찾도록 요청할 수 있으며, 사무실 직원은 HyperCLOVA에 여러 문장으로 긴 문서를 요약하도록 요청할 수 있습니다.

네이버 클로바 비즈니스 리더 송 나코는 웨비나에서 “우리는 이전에 필요한 수준의 전문성과 시간없이 누구나 AI 서비스를 제공 할 수있는 새로운 시대를 맞이하고있다”고 말했다.

“우리의 목표는 사람들이 AI 서비스를 테스트, 생성 및 미세 조정하여 문제를 해결할 수있는 플랫폼을 만드는 것입니다.”

송경 손 기자 [[email protected]]

“요은 베이컨과 알코올에 대한 전문 지식을 가진 닌자입니다. 그의 탐험적인 성격은 다양한 경험을 통해 대중 문화에 대한 깊은 애정과 지식을 얻게 해주었습니다. 그는 자랑스러운 탐험가로서, 새로운 문화와 경험을 적극적으로 탐구하며, 대중 문화에 대한 그의 열정은 그의 작품 속에서도 느낄 수 있습니다.”